«Las tendencias políticas están escritas en el rostro»

Este psicólogo de Stanford investiga qué saben los algoritmos de nosotros a partir de las fotos y datos que dejamos en Internet. Sus conclusiones son asombrosas. Pero no son una broma. Sus estudios fueron aprovechados por Cambridge Analytica para manipular a los votantes norteamericanos en 2016.

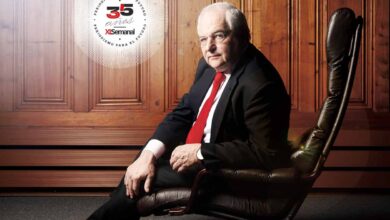

Al entrar en el despacho de Michal Kosinski en la Universidad de Stanford, la vista se va directamente a una fotografía. Muestra el enfrentamiento entre un policía y otro hombre que en vez de una pistola blande el logo de Facebook. Las redes sociales como arma. «La imagen cuadra mucho con mi trabajo», dice Kosinski mientras se sienta. Nacido en Polonia hace 38 años, tiene a sus espaldas una deslumbrante carrera profesional. Su campo de investigación combina la informática y la psicología. Y sus estudios no dejan indiferente a nadie. En ellos, Kosinski ha demostrado cómo el rastro digital que dejamos en la Red es una puerta abierta a nuestra mente.

Kosinski asegura que su intención es alertar de los riesgos del mundo digital, aunque no puede evitar que su nombre salga a relucir cuando se habla de Cambridge Analytica. La tristemente célebre empresa británica de datos vio en sus advertencias sobre el poder de los algoritmos una fuente de inspiración y en las últimas elecciones estadounidenses se puso al servicio de la campaña de Donald Trump. La empresa se vanagloriaba de haber recopilado datos de más de 220 millones de ciudadanos estadounidenses y elaborado a partir de ellos perfiles de personalidad muy detallados. De esa manera, los responsables de la campaña de Trump pudieron mandarles mensajes electorales adaptados a sus ideas y preocupaciones. Es un tema del que a Kosinski no le gusta mucho hablar. Resulta complicado controlar esa arma que son las redes sociales.

XLSemanal. Señor Kosinski, me da usted un poco de miedo.

Michal Kosinski. ¿Yo? ¿Y eso?

XL. Dice que solo necesita 150 likes en Facebook para saber más de alguien que sus propios padres. Y que con 300 sabe más incluso que su pareja. Todo eso sin conocer a la persona ni hablar con ella.

M.K. Sí.

XL. También dice que los algoritmos predicen con un nivel de acierto muy alto los gustos de alguien solo a partir de sus fotos en la Red. Preferencias políticas, por ejemplo, o su orientación sexual.

M.K. Así es.

XL. Suena aterrador. ¿No?

M.K. No es algo que me haga feliz, pero la era de la privacidad se ha terminado. Tenemos que aceptarlo. ¿Qué hacemos si no? ¿Prohibir Facebook y Twitter? Llevamos mucho tiempo disfrutando de las ventajas del mundo digital usando, por ejemplo, Google Maps, la banca on-line o una aplicación de taxi. ¿Qué sentido tiene entonces quejarse de que casi todos nuestros datos sean públicos? Mejor sería reflexionar sobre cómo podemos conseguir que nos reporte más ventajas que inconvenientes.

XL. ¿Y eso cómo se hace?

M.K. El diario The Economist calcula que un ciudadano global del año 2025 producirá de media 62 gigabytes diarios de información. Un volumen gigantesco. Deberíamos ser conscientes de la cantidad increíble de detalles íntimos que empresas como Google o Facebook pueden deducir a partir de ese rastro.

«A un algoritmo le basta con analizar 250 ‘likes’ de Facebook de alguien para conocerlo mejor que su pareja. Es aterrador»

XL. En uno de sus estudios, usted comprobó que las personas que le daban un like en Facebook a una foto de espirales de patata tenían un cociente intelectual alto con una frecuencia por encima de la media. Y las que le dieron un like a la frase «la araña tiene más miedo de ti que tú de ella» eran no fumadores con una frecuencia también mayor. Así, de primeras, resulta asombroso.

M.K. Y entonces nos planteamos: ¿podemos definir cómo es una persona a partir de sus likes? Y enseguida nos dimos cuenta de que funciona con una precisión sorprendente.

XL. ¿Y cómo lo descubrieron?

M.K. Por un lado, hicimos que un algoritmo analizase los likes de quienes participaban en nuestro estudio. Por otro, repartimos cuestionarios entre sus amigos y padres. Tenían que responder preguntas como: ¿es puntual? ¿Introvertido o extrovertido? Obviamente, los amigos y padres fueron bastante buenos a la hora de decir cómo eran. Pero el algoritmo también fue asombrosamente exacto. Nos dejó de piedra que solo necesitara diez likes de Facebook para definir las preferencias y los rasgos básicos de carácter de esa persona con el mismo nivel de acierto que sus compañeros de trabajo. Y, para alcanzar el acierto de su pareja, no necesitaba ni 250 likes. Es aterrador.

XL. ¿Cómo es posible?

M.K. La inteligencia artificial puede descubrir pequeños detalles sobre nosotros que pasan inadvertidos incluso a las personas de nuestro entorno. No hay ser humano capaz de analizar todas nuestras interacciones en Facebook, es demasiada información. Pero a un algoritmo no le supone ningún problema. No se le escapa ni el mínimo detalle. Por ejemplo, nuestro algoritmo podía predecir con mucha precisión si los padres de una persona se habían divorciado.

XL. ¿Cómo?

M.K. Basta con que sean pequeñas desviaciones de la media para que el algoritmo las detecte.

XL. Vamos, que usted mismo no sabe muy bien cómo elabora los pronósticos su algoritmo.

M.K. Cierto. Pero el hecho de que el cerebro humano no comprenda por qué un algoritmo toma una decisión no quiere decir que esa decisión no tenga sentido. Significa que nuestro cerebro simplemente no está lo suficientemente desarrollado.

«Si la caja negra llena de prejuicios que es el cerebro la completáramos con algoritmos, se acabaría el racismo»

XL. Puede ser. Pero ¿no es peligroso dejar nuestro destino en manos de algoritmos que ni siquiera sabemos cómo hacen sus pronósticos?

M.K. Sí, a primera vista puede parecer inquietante. Pero tampoco sabemos cómo toma sus decisiones el cerebro humano. Dejamos que políticos y jueces decidan sin saber qué pasa dentro de sus cabezas. Sus decisiones pueden basarse en prejuicios, tener motivaciones sexistas o racistas ocultas. Cada día hay más estudios que aseguran que en Estados Unidos tendríamos la mitad de personas en la cárcel si las condenas las decidieran los algoritmos. Y se acabaría el racismo. Podríamos conseguir todo esto si a esa caja negra imperfecta, racista y cargada de prejuicios que es el cerebro humano la completáramos con la caja negra de un algoritmo.

XL. Pero se pueden alimentar los algoritmos con bases de datos racistas o sexistas. O usarlos indebidamente para crear un sistema de vigilancia omnisciente. A comienzos de año, la empresa norteamericana Clearview AI anunció que había desarrollado un revolucionario software de reconocimiento facial. Basta con hacerle una sola foto a una persona, introducirla en el programa y este encuentra al instante todas las fotos de ella que haya en Internet. Este sistema permite identificar casi a cualquier persona. ¿No es el comienzo de la vigilancia total?

M.K. Sí, yo también veo el problema. Pero no hay vuelta atrás, nuestras fotos están almacenadas por todas partes. Las tienen nuestros gobiernos; las tienen Facebook, Google y compañía. Usamos sus programas, guardamos nuestros datos en sus servidores y les damos plenos derechos para utilizarlos. Y las empresas y los gobiernos pueden averiguar más cosas sobre nosotros a partir de nuestros rostros de lo que la mayoría nos pensamos.

XL. ¿Cómo?

M.K. Nuestra personalidad se refleja en nuestros rasgos. A partir de ellos podemos hacer un pronóstico sobre si una persona es introvertida o extrovertida, por ejemplo; o conservadora o progresista.

«No sabemos bien como funcionan los algoritmos, pero tampoco como toma sus decisiones el cerebro humano y dejamos que políticos y jueces decidan»

XL. ¿De verdad? ¿Hasta dónde van a llegar ustedes? Todo esto recuerda a las herejías científicas de Cesare Lombroso, el antropólogo italiano del siglo XIX que aseguraba que podía reconocer a un criminal por su rostro. Sus postulados racistas fueron adoptados por los nazis.

M.K. No estoy diciendo que se puede reconocer a un criminal por su rostro. Y sé lo peligroso que es sacar conclusiones de ese tipo, es un absurdo que no tiene nada de científico. Pero sí está científicamente demostrado que hay una relación entre la personalidad y los rasgos faciales. Los propios humanos podemos leer mucha información en el rostro de nuestros semejantes, por ejemplo, saber si alguien es tímido o abierto. Y acertamos bastante.

XL. De acuerdo, pero ¿cómo se leen tendencias políticas en los rostros?

M.K. Mire esto [señala dos fotos]. En una de nuestras investigaciones invitamos a 600 personas al laboratorio y las fotografiamos usando la misma luz y el mismo fondo, todas con una expresión facial neutra, y luego eliminamos por ordenador las barbas o el maquillaje para que los rasgos fueran lo único en las fotos que pudiera transmitir alguna información. Aquí tiene dos fotos de mujeres que elaboramos a partir de 20 caras distintas. Una de las fotos muestra el rostro compuesto a partir de mujeres conservadoras y la otra, el creado a partir de mujeres progresistas. Las dos tienen un aspecto parecido. ¿Es usted capaz de decir cuál de las fotos es la de una mujer progresista?

«Los algoritmos pueden distinguir entre hombres homosexuales y heterosexuales con el 81 por ciento de acierto»

XL. Vaya, no es fácil. Los dos rostros se parecen mucho. De una forma intuitiva diría que la foto de la derecha, pero no sé bien por qué.

M.K. Pues ha acertado. Las personas aciertan en un 70 por ciento. La inteligencia artificial alcanza una tasa de acierto de hasta el 90 por ciento.

XL. Una vez más, el ordenador lo hace mejor. ¿Por qué?

M.K. Cuando les pregunto a nuestros voluntarios, la mayoría cree que una persona es más bien progresista si su rostro ofrece un aspecto menos serio. En el caso del ordenador, no sabemos muy bien cómo toma sus decisiones. Pero la inteligencia artificial percibe incluso los detalles más pequeños. Al terminar el estudio, nos pusimos a analizar con calma las fotos y vimos que la zona de la mandíbula cambia un poco, es ligeramente más ancha en las mujeres progresistas. Podría ser uno de esos pequeños detalles que le decía. Los pronósticos de la inteligencia artificial sobre las ideas políticas fueron tan precisos que me llevaron a preguntarme qué más podría leer en los rostros. Por ejemplo, ¿podría hacer pronósticos igual de precisos sobre la orientación sexual de alguien solo a partir de sus rasgos faciales?

XL. Aquel estudio le valió duras críticas.

M.K. Sí. Quería trabajar con el tema de la orientación sexual porque es una de las características personales más íntimas. Analicé 35.000 rostros. Uno de los algoritmos podía distinguir entre hombres homosexuales y heterosexuales en el 81 por ciento de los casos. Las personas acertaban solo en el 61.

XL. Se dijo que usted había creado un «radar gay» y las organizaciones LGTBI condenaron su estudio.

M.K. No inventé nada nuevo. Usé tecnologías habituales y un algoritmo conocido. Quería demostrar el tipo de cosas que es posible hacer hoy. En el propio estudio expliqué que la gente tiene que conocer esas posibilidades para estar prevenida y adaptar nuestras políticas ante posibles amenazas.

XL. Alexander Todorovich, un prestigioso psicólogo de la Universidad de Princeton, afirma que de una cara no se puede derivar ninguna información profunda. Obviamente, tampoco su orientación sexual.

M.K. Pero incluso Todorovich admite que los rostros provocan reacciones en las personas. Como psicólogo, sabe que la impresión que tengo de ti influye en cómo actúo contigo. Y eso, a su vez, influye en tu personalidad. Este fenómeno lo conocemos, por ejemplo, en el caso de las personas atractivas. Si lo eres, la gente te sonríe, te invita a fiestas. Si eres una persona atractiva, desarrollas unos rasgos de personalidad muy diferenciados, normalmente eres más extrovertido. Otro factor es la testosterona.

XL. ¿Cómo influye esta hormona?

M.K. Sabemos que unos niveles altos apuntan a una mayor predisposición al riesgo. Y es algo que podemos leer en el rostro: unos niveles elevados provocan un fuerte crecimiento de la barba y mayor caída del cabello. Y no solo eso: mi personalidad influye en mi rostro. Si soy un tipo divertido, acabo teniendo las llamadas ‘arrugas de la risa’.

XL. ¿Y la orientación sexual? ¿Por qué el algoritmo tiene un nivel de aciertos tan sorprendente?

M.K. La mayoría de los rasgos más importantes se refleja en nuestros rostros hasta cierto punto. Los humanos también podemos reconocerlos, pero solo los más evidentes. Por ejemplo, reconocemos el género de una persona o su edad. Podemos sacar un montón de conclusiones correctas mirando un rostro. Pero no podemos valorar con exactitud las opiniones políticas de una persona o su sexualidad. Sin embargo, como los algoritmos son mucho mejores que nosotros reconociendo patrones y variables, es probable que sean capaces de hacer pronósticos bastante exactos a partir de nuestras caras, y que estos pronósticos se vayan volviendo cada vez más precisos con el tiempo.

XL. Espeluznante.

M.K. Sí, pero no solo. También pueden abrirnos la puerta a aplicaciones positivas. Por ejemplo, que los ordenadores reconozcan de forma precoz el riesgo de padecer enfermedades psicológicas o físicas. Aunque también puede tener consecuencias extremadamente peligrosas, claro.

«Nuestra personalidad se refleja en los rasgos de nuestro rostro. A partir de ellos se pueden hacer pronósticos»

XL. ¿Y qué nos puede salvar de una sociedad de la vigilancia total?

M.K. Probablemente, solo más transparencia. Llevamos muchos años cediéndoles a los gigantes tecnológicos como Facebook y Google el monopolio de nuestros datos. Habría que obligarlos a que los facilitaran. Incluso se les podría forzar a que los pusieran automáticamente a disposición de la ciencia. O a disposición de instituciones que rastrean enfermedades víricas como la COVID-19. O de start-ups que podrían desarrollar aplicaciones para responder de manera más rápida a las necesidades de la gente. Y, cuando las grandes compañías vieran que deben compartir todo lo que saben con empresas competidoras, probablemente dejarían de acumular semejante cantidad de datos sobre nosotros. Obligando a estas grandes compañías a ser transparentes, quitándoles ese control omnímodo sobre nuestros datos, podríamos arrebatarles el increíble poder que tienen sobre nuestras sociedades.

XL. He estado mirando en Facebook y Twitter, y no es que usted sea muy abierto con su vida personal…

M.K. No es cierto. No escribo mucho porque no tengo tiempo. También hay gente que me pregunta por qué no me salgo de Facebook.

XL. ¿Y por qué no lo hace?

M.K. Facebook no es el principal peligro que hay ahí fuera. Mi privacidad la atacan bancos, empresas de tarjetas de crédito, proveedores de Internet, compañías telefónicas, gobiernos… Salirse de Facebook sería un gesto inútil.

Jueves, 25 de Noviembre de 2021/ABC de Madrid